JS Park, JC O’Brien, CJ Cai, M. Morris, P. Liang, MS Bernstein

Un gruppo di ricercatori della Stanford University e di Google ha creato un mondo in miniatura virtuale in stile RPG simile a sims, dove 25 personaggi, controllati da ChatGPT e codice personalizzato, vivono la loro vita in modo indipendente con un alto grado di realismo. Hanno scritto della loro esperienza in Carta accademica prestampata Rilasciato venerdì.

“Gli agenti generatori si svegliano, preparano la colazione e si mettono al lavoro; gli artisti dipingono, mentre gli autori scrivono; si formano opinioni, si annotano a vicenda e attaccano conversazioni; ricordano e riflettono sui giorni passati mentre pianificano il prossimo.” scrivono i ricercatori cartaAgenti generativi: simulacri interattivi del comportamento umano.

Per raggiungere questo obiettivo, i ricercatori hanno fatto molto affidamento su un modello di linguaggio di grandi dimensioni (LLM) per l’interazione sociale, in particolare l’API ChatGPT. Inoltre, hanno creato un’architettura che simulava menti con ricordi ed esperienze, e poi ha permesso agli agenti di muoversi nel mondo per interagire. E anche gli umani possono interagire con loro.

“Gli utenti possono monitorare e intervenire quando i clienti pianificano le loro giornate, condividono notizie, formano relazioni e coordinano le attività di gruppo”, scrivono. È opera di Jeon Sung Park, Joseph C. O’Brien, Carrie JK, Meredith Ringle Morris, Percy Liang e Michael S. Bernstein.

Computer e videogiochi hanno caratterizzato personaggi controllati dal computer sin dagli anni ’70, ma mai prima d’ora sono stati in grado di simulare un ambiente sociale con la complessità del linguaggio naturale che ora potrebbe essere possibile grazie a modelli di intelligenza artificiale generativa come ChatGPT. Sebbene la ricerca del gruppo non sia necessariamente un “gioco”, potrebbe essere un prototipo per un futuro in cui i personaggi dinamici dei giochi di ruolo interagiscono in modi complessi e imprevedibili.

“Immagina di uccidere un NPC e tornare in città e vedere un funerale per loro. Dennis Hansen Quando si risponde a un argomento sulle implicazioni emergenti del documento. Sulla base di questa ricerca, questo potrebbe non essere uno scenario inverosimile.

La vita a Smallville

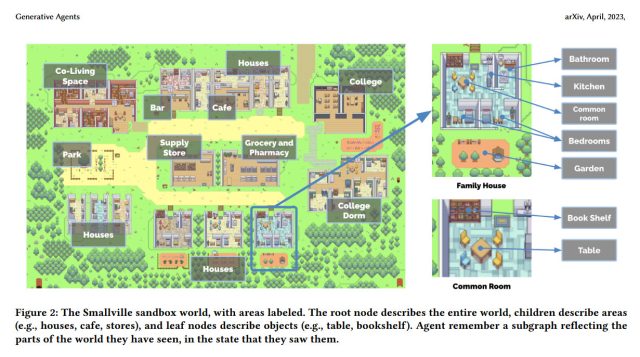

Per studiare il gruppo di clienti AI, i ricercatori hanno creato una città virtuale chiamata “Smallville”, che comprende case, una caffetteria, un parco e un negozio di alimentari. Ai fini dell’interazione umana, il mondo è rappresentato sullo schermo da una vista dall’alto utilizzando una grafica in pixel in stile retrò che ricorda un classico gioco di ruolo giapponese a 16 bit.

Smallville ospita una comunità di 25 individui distinti, ciascuno rappresentato da un avatar principale. Per catturare l’identità di ogni agente e le sue relazioni con gli altri membri della comunità, i ricercatori hanno creato un paragrafo per descrivere il linguaggio naturale come un seme di memoria. Queste descrizioni includono dettagli sulla professione di ciascun agente e sui rapporti con altri agenti. Ad esempio, ecco un estratto da una di queste memorie grezze fornite nel documento:

John Lin è un proprietario di un negozio di Willow Market e Pharmacy che ama aiutare le persone. È sempre alla ricerca di modi per semplificare il processo di ottenimento dei farmaci per i suoi clienti. John Lin vive con sua moglie May Lin, una professoressa universitaria, e il figlio Eddie Lin, uno studente di teoria musicale. John Lin ama molto la sua famiglia.

In quanto ambiente virtuale, Smallville è suddiviso in regioni e oggetti. Gli utenti umani possono entrare nel mondo come agenti esistenti o nuovi e sia gli utenti che gli agenti possono influenzare lo stato delle cose attraverso le azioni. Gli utenti umani possono anche interagire con gli agenti di intelligenza artificiale attraverso la conversazione o impartendo indicazioni come una “voce interiore”. Gli utenti comunicano in linguaggio naturale, specificando una personalità che l’agente comprende o che può utilizzare la voce interiore per influenzare le azioni dell’agente.

Nello sviluppo del mondo virtuale, una delle sfide è venuta dalla “memoria” limitata degli LLM. Questa memoria si presenta come una “finestra di contesto”, che è il numero di token (parti di parole) che ChatGPT può elaborare alla volta. Per aggirare queste limitazioni, i ricercatori hanno progettato un sistema in cui “le parti più rilevanti della memoria di un lavoratore” vengono recuperate e sintetizzate quando necessario.

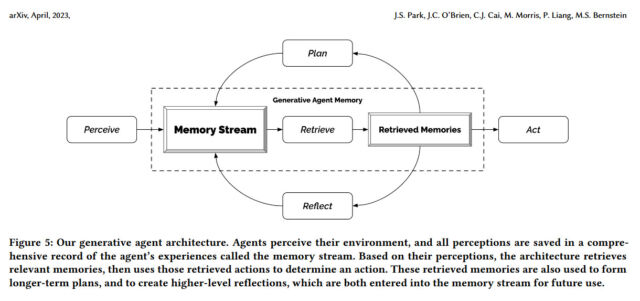

Gli agenti sono consapevoli del loro ambiente e tutte le percezioni vengono salvate in un registro completo delle esperienze dell’agente chiamato flusso di memoria.In base alle loro percezioni, il costrutto recupera i ricordi rilevanti e quindi utilizza quelle azioni richiamate per determinare l’azione.Questi ricordi richiamati sono anche usati per formare piani a lungo termine e per creare riflessi rilevanti di livello superiore, ed entrambi sono inseriti nel flusso di memoria per un uso futuro.

È interessante notare che quando i personaggi nel mondo sandbox si incontrano, spesso parlano tra loro utilizzando il linguaggio naturale fornito da ChatGPT. In questo modo si scambiano informazioni e formano ricordi della loro vita quotidiana. Quando i ricercatori hanno riunito questi componenti di base e hanno eseguito le simulazioni, sono iniziate ad accadere cose interessanti.

Comportamento emergente

Nel documento, i ricercatori riportano tre comportamenti emergenti inaspettati risultanti dalla simulazione. Nessuno di questi era pre-programmato, ma piuttosto il risultato di interazioni tra fattori.

Questi includevano “diffusione di informazioni” (agenti che si scambiano informazioni e le diffondono socialmente in città), “memoria relazionale” (memoria delle interazioni passate tra agenti e successiva rievocazione di quegli eventi passati) e “coordinamento” (pianificazione e partecipazione a un San Valentino Festa diurna con altri agenti). .

Durante la prova di San Valentino, un’agente di intelligenza artificiale di nome Isabella Rodriguez ha organizzato una festa di San Valentino all’Hobbs Café e ha invitato amici e clienti. Decora il caffè con l’aiuto della sua amica Maria, che invita alla festa il suo amante Klaus.

“A partire da un solo indizio definito dall’utente che un agente vuole organizzare una festa di San Valentino”, hanno scritto i ricercatori, “gli agenti hanno pubblicato in modo indipendente inviti alla festa nei due giorni successivi, hanno fatto nuove conoscenze, si sono chiesti a vicenda su date per la festa, e coordinati per presentarci insieme alla festa “puntuali”.

Mentre 12 clienti hanno sentito parlare della festa attraverso altri, solo cinque clienti (inclusi Klaus e Maria) si sono presentati. Tre di loro hanno detto di essere troppo occupati e quattro clienti non sono andati. L’esperimento è stato un divertente esempio delle situazioni inaspettate che possono derivare da complesse interazioni sociali nel mondo virtuale.

Più umano dell’umano?

Come parte della loro ricerca, il gruppo ha chiesto a valutatori umani di osservare le ri-simulazioni per misurare quanto bene gli agenti di intelligenza artificiale producevano comportamenti credibili basati sul loro ambiente e sulle loro esperienze, inclusi “piani, reazioni e idee ragionevoli” e “diffusione di informazioni e formazione di relazioni e coordinamento degli agenti attraverso le diverse sacche della società”.

I ricercatori hanno anche chiesto agli umani di recitare le risposte degli agenti alle domande dell’intervista con la voce dell’agente che hanno visto riprodotto. È interessante notare che hanno scoperto che il “costrutto completo del fattore generativo” ha prodotto risultati più credibili rispetto agli umani che giocano di ruolo.

Questo porta ad altri problemi, come le implicazioni etiche ei rischi di questa tecnologia. I ricercatori hanno avvertito di rischi come la formazione di “relazioni sociali” inappropriate, l’impatto di inferenze errate, l’esacerbazione dei rischi esistenti associati all’IA generativa e il rischio di un eccessivo affidamento su fattori generativi nel processo di progettazione.

Per garantire una pubblicazione etica e socialmente responsabile, i ricercatori sostengono che gli sviluppatori dovrebbero aderire a principi come rivelare esplicitamente la natura computazionale degli agenti, garantire la compatibilità dei valori, seguire le migliori pratiche nella progettazione dell’IA umana, mantenere registri di controllo di input e output e non sostituire input umani reali negli studi e nei processi.il design.

Per uno sguardo a Smallville, i ricercatori hanno pubblicato un dossier Esposizione interattiva online tramite un sito Web proprietario, ma si tratta di una “ri-simulazione pre-calcolata” descritta nel documento e non è una simulazione in tempo reale. Tuttavia, fornisce una buona illustrazione della ricchezza delle interazioni sociali che possono emergere da un mondo virtuale apparentemente semplice che gira in una sandbox del computer.

“Esperto di Internet. Lettore. Fanatico della TV. Comunicatore amichevole. Esperto di alcolisti certificato. Appassionato di pancetta. Esploratore. Evil twitteraholic.”